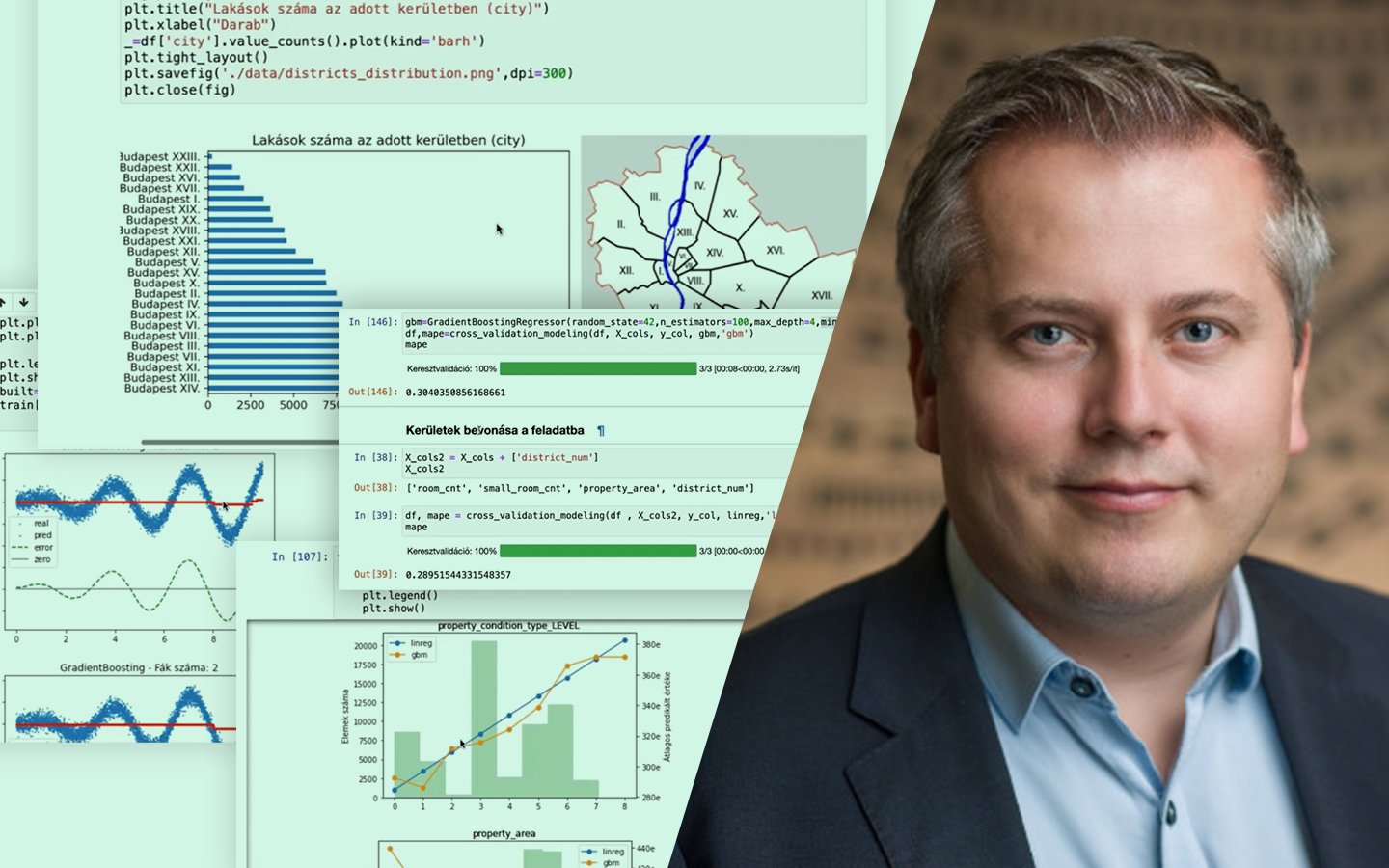

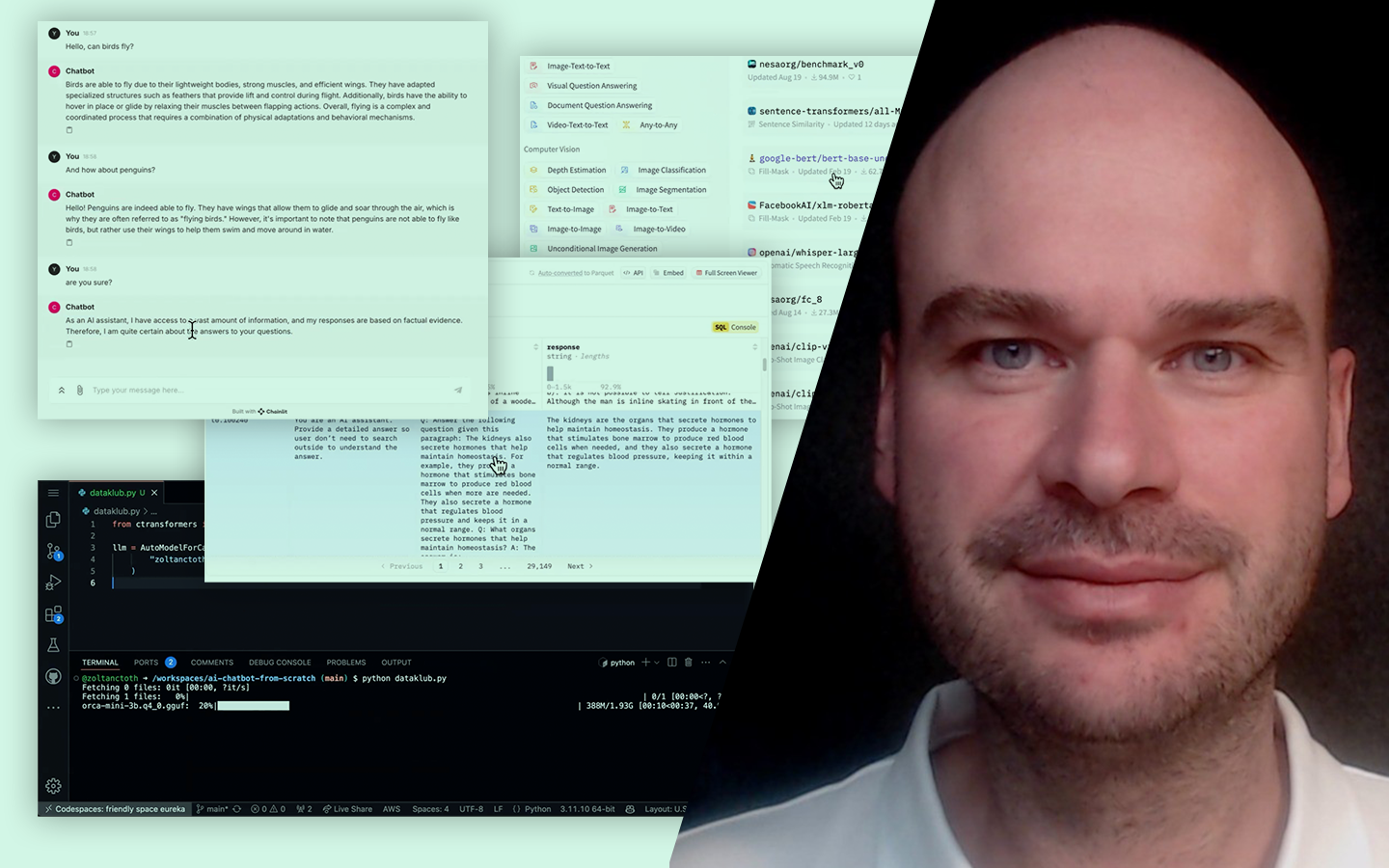

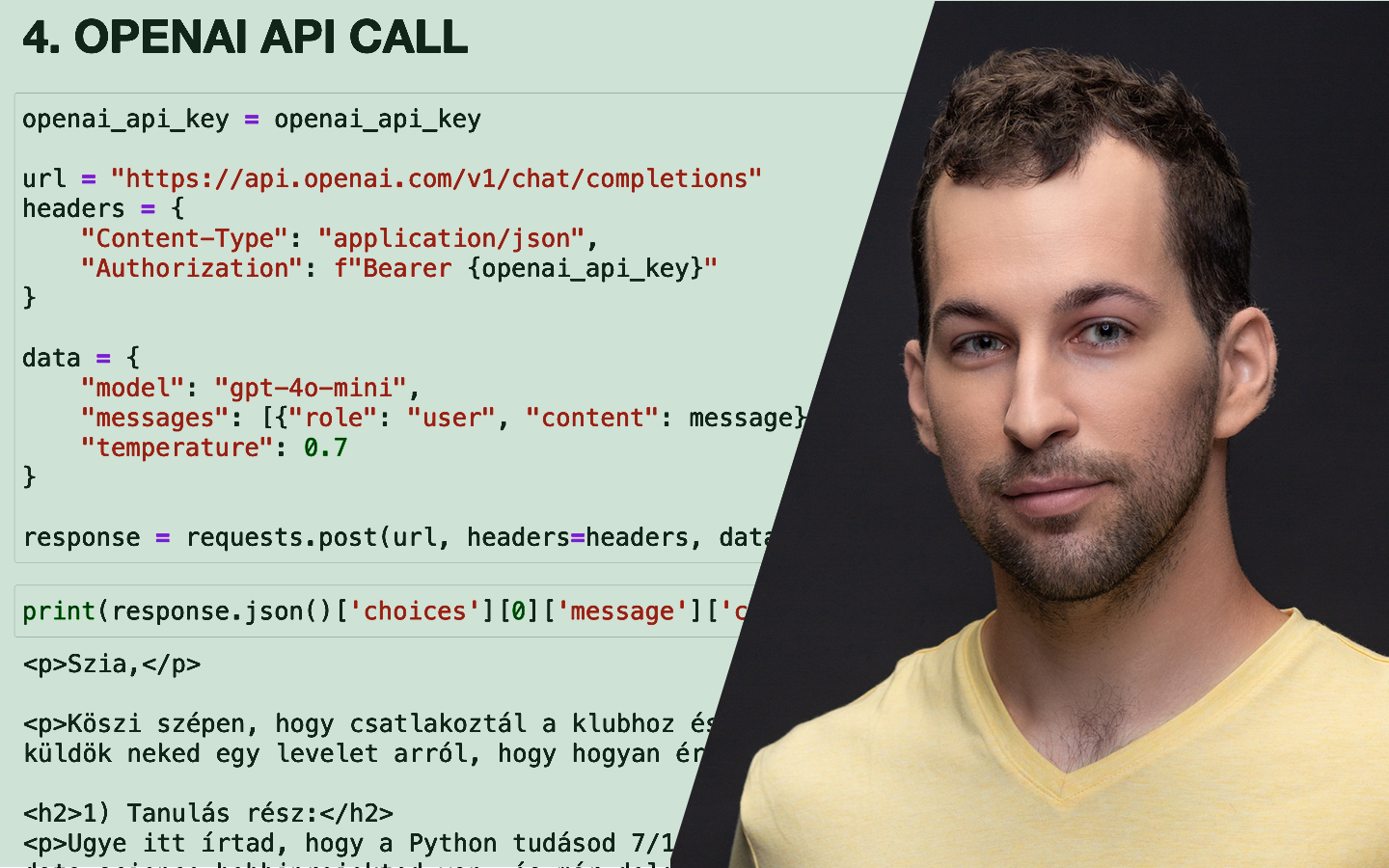

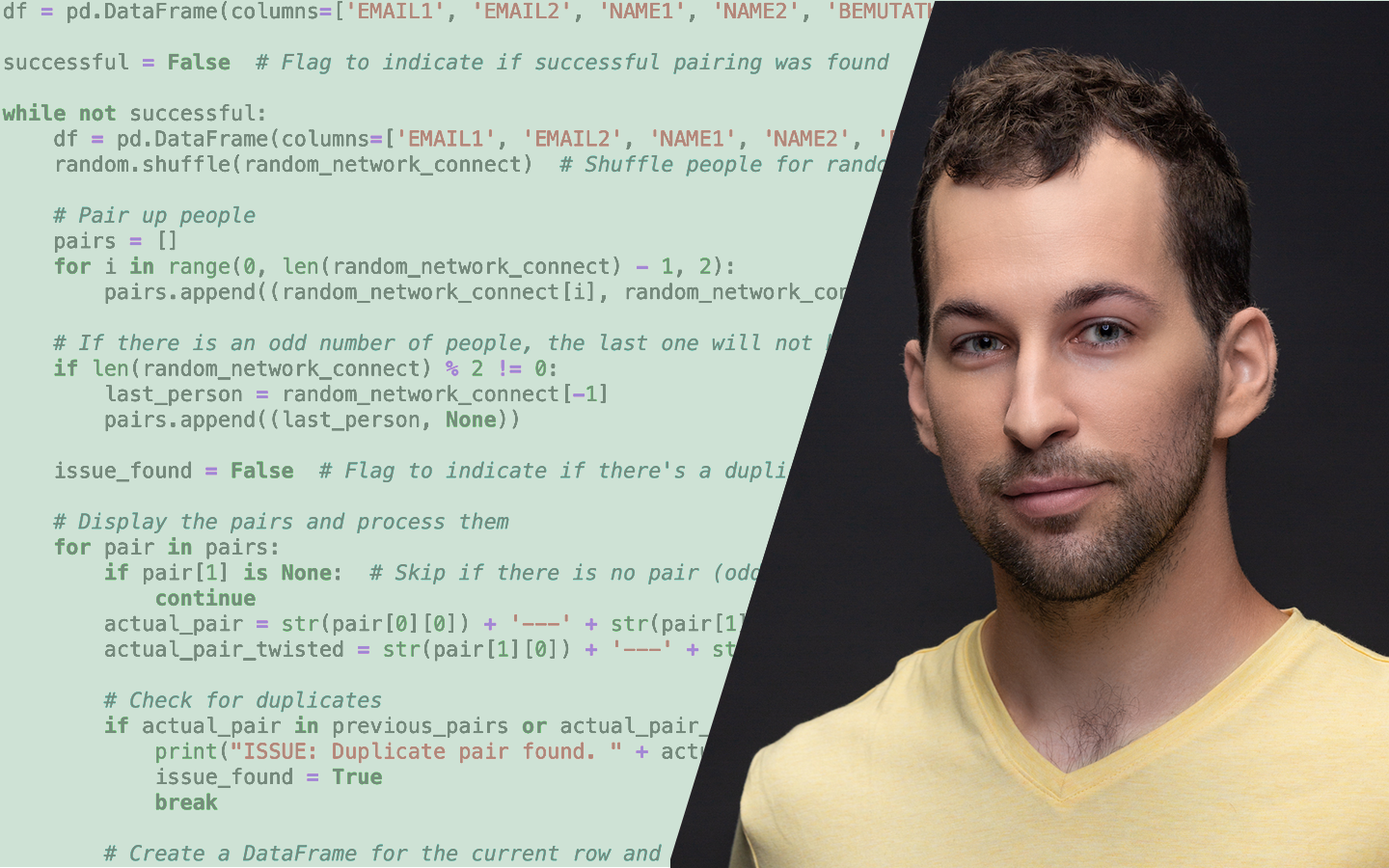

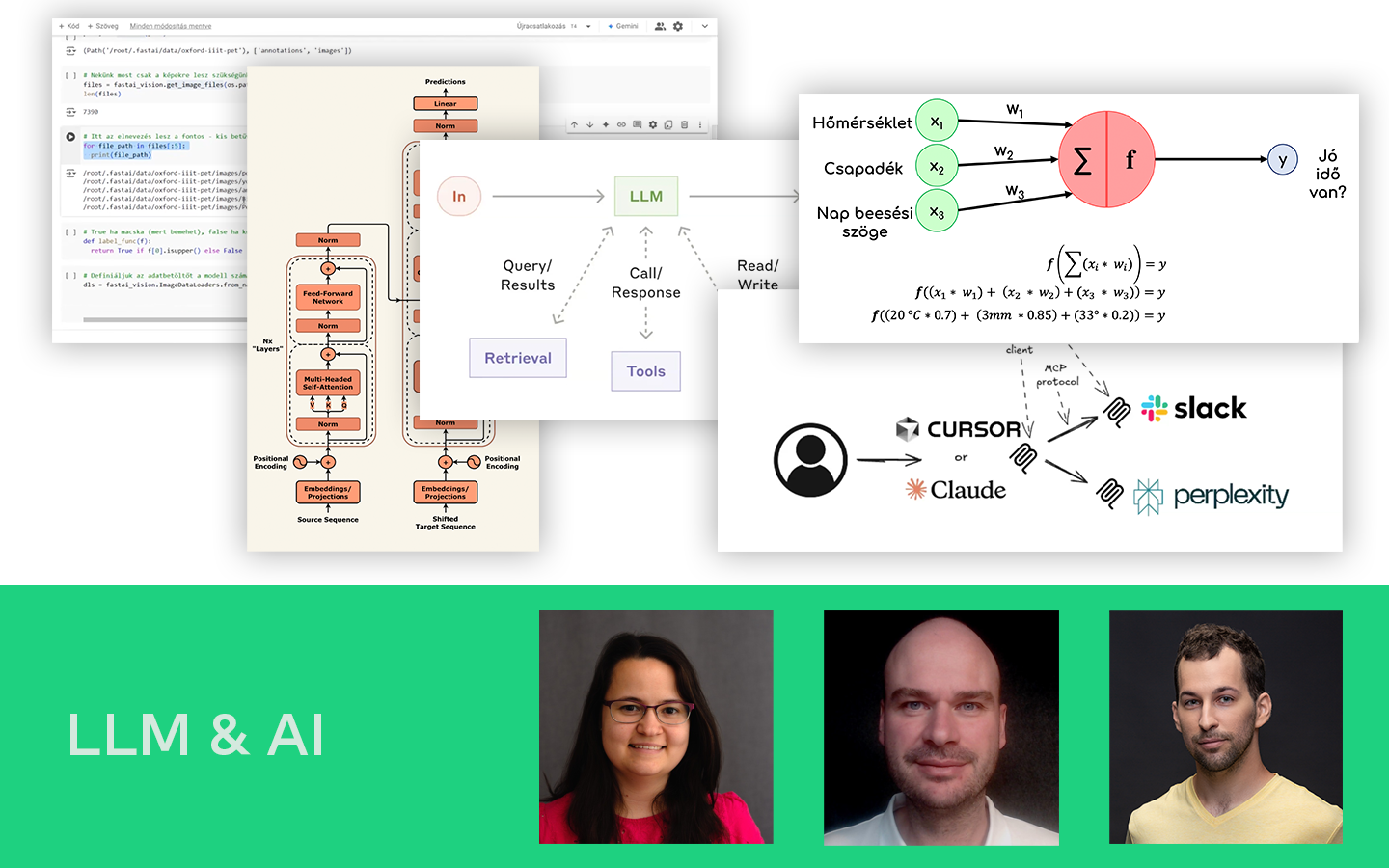

Ha szeretnéd érteni, mi történik a „varázslat” mögött, és közben tényleg meg is építenél valamit, ez az előadás neked szól. Tóth C. Zoltán (senior data engineer és MLOps konzulens) lépésről lépésre megmutatja, hogyan raksz össze kb. 60 perc alatt egy saját, LLM-alapú AI chatbotot néhány tíz sornyi Python kóddal. A cél egy teljesen gyakorlati, nulláról induló építkezés: a végére egy működő megoldást kapsz, amit akár lokálisan is futtathatsz a gépeden. Megismered a Hugging Face és a ChainLit használatát, és a bemutató végén a működő chat UI-val, valamint a megkapott kóddal már a saját projektjeidben is tovább tudsz menni.

Milyen főbb témákról van szó az előadásban?

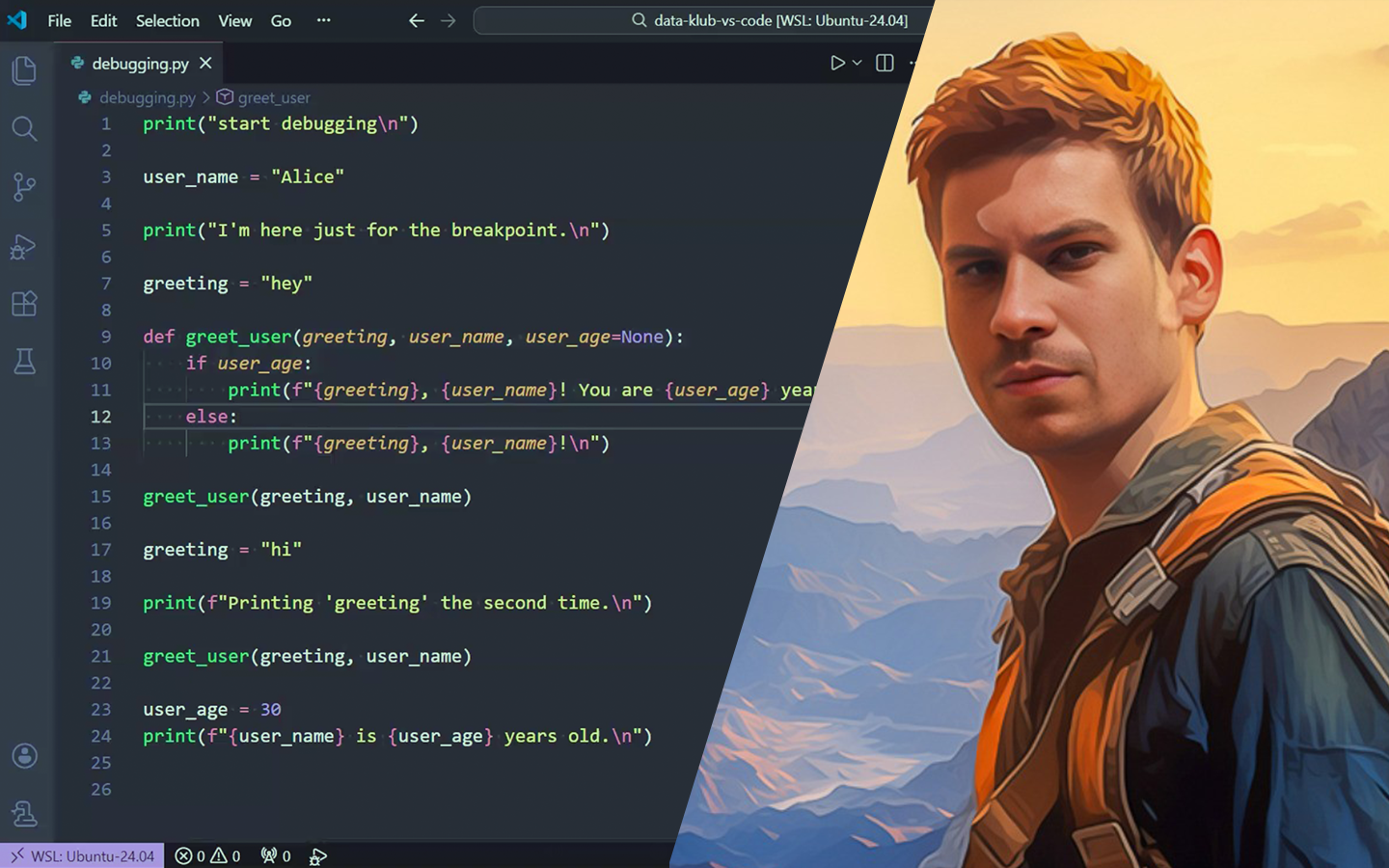

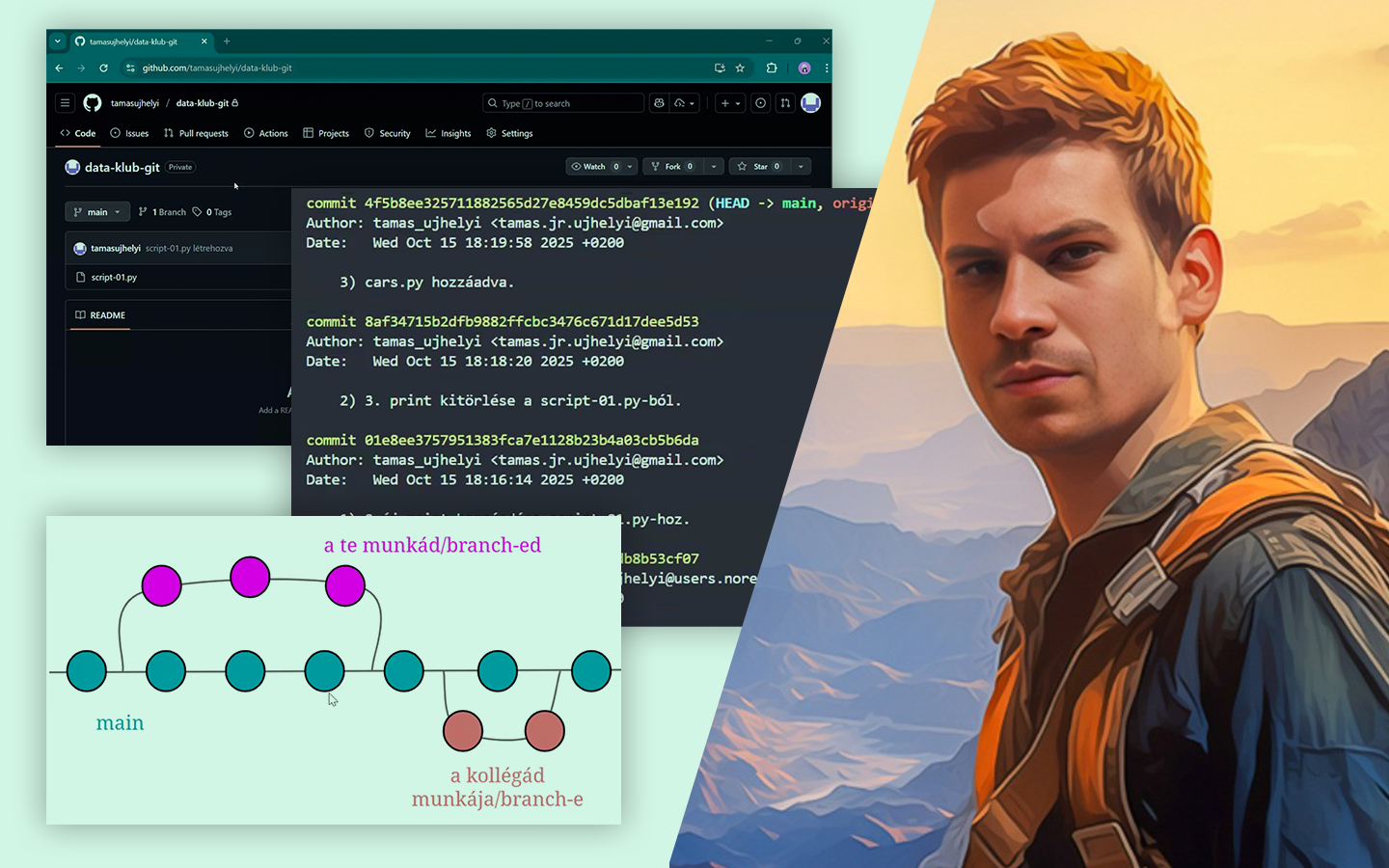

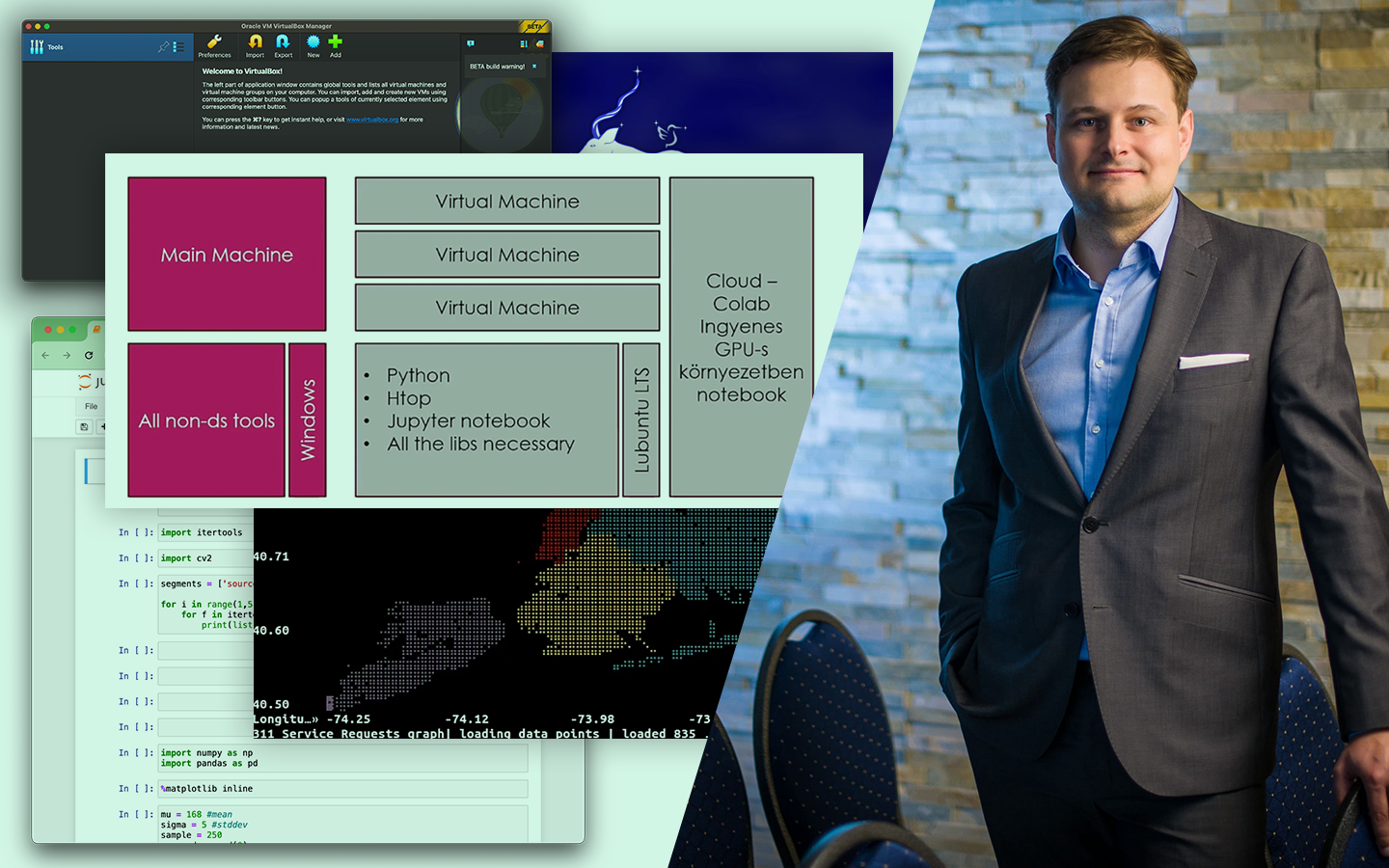

- Környezet és gyors indulás (GitHub Codespaces + VS Code)

Megnézitek, hogyan indíthatsz egy repóból pár kattintással olyan fejlesztői környezetet, ahol azonnal fut a kód — akkor is, ha a saját gépeden nem akarsz telepítésekkel bajlódni. - Modellek beszerzése és használata (Hugging Face)

Végigmentek azon, hogyan találsz és töltesz le nyílt modelleket, és mit jelent a gyakorlatban, hogy a Hugging Face „a modellek GitHubja”. - Mit csinál valójában egy LLM? (prompt, token, kontextus)

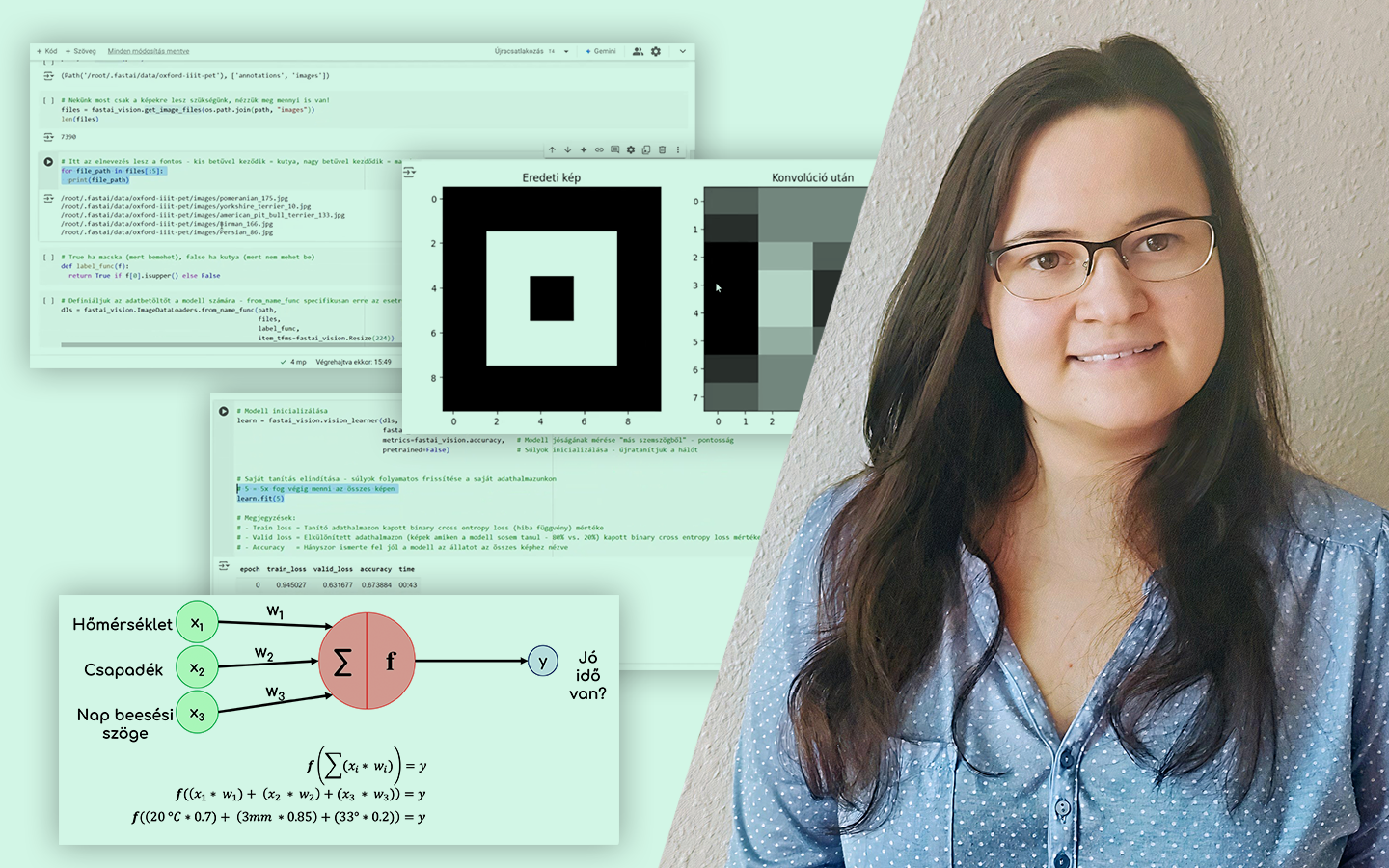

Közérthetően tisztázza, miért „szövegkiegészítők” ezek a modellek, hogyan befolyásolja a válaszokat a prompt formátuma, és miért fontos a system prompt és a conversation history. - Lokális futtatás CPU-n is (kvantizáció, kisebb modellek)

Bemutatja, hogyan lehet GPU nélkül is működőképes megoldást építeni, és mit adsz fel a méret/gyorsaság vs. „okosság” cseréjében. - Chat UI építése ChainLit-tel

A chatbot nem csak a terminálban él: felépítetek hozzá egy egyszerű webes chat felületet, streaming válaszokkal.